Durant les dernières élections municipales, sur les réseaux sociaux, certains candidats semblaient disposer d’une bien meilleure visibilité que d’autres. Est-ce uniquement grâce à leur grand talent d’influenceur capable d’optimiser l’exploitation des réseaux sociaux ? Si certains s’en tirent effectivement bien, cela ne suffit pas à tout expliquer, notamment sur le réseau X d’Elon Musk. C’est sur celui-ci que cette impression d’une mise en avant de certaines personnalités ou sujets semblait prédominante. Et justement, ce n’était pas qu’une impression.

Rappelons d’abord que le réseau X est loin d’être neutre politiquement et c’est plus ou moins assumé. Elon Musk, le milliardaire, qui a soutenu activement la campagne de Donald Trump, a également joué un rôle central – bien que juridiquement flou – au sein du Department of Government Efficiency (Doge), chargé de restructurer l’administration fédérale.

Sans jamais revendiquer explicitement un usage partisan de sa plateforme, Musk a régulièrement transformé X en un levier d’influence idéologique, notamment à travers ses prises de position publiques et les évolutions de ses algorithmes. X est clairement un outil politique pour Musk. Et c’est un outil qui propage des idées proches du pouvoir actuel.

Une enquête solide

Il fallait encore le prouver et des scientifiques l’ont fait en menant des expérimentations sur un large panel d’utilisateurs de X durant l’année 2023. C’était une année charnière pour la campagne électorale de Trump.

Le collectif de scientifiques a publié ses résultats dernièrement dans la revue Nature. Leur étude confirme l’intuition que X n’est pas un réseau comme les autres. Selon leur enquête, l’algorithme de la plateforme est programmé sciemment pour modifier durablement les opinions politiques de ses utilisateurs.

Tags :

sante

Voici comment on peut vous manipuler sans que vous vous en rendiez compte

Lire l’article

Mais avant d’en savoir plus, rappelons comment l’algorithme de X met en avant certaines publications et pas d’autres. Sur le papier, comme pour n’importe quel réseau social, le modèle est simple. L’algorithme privilégie les contenus qui suscitent le plus d’engagement. Mais toutes les interactions ne se valent pas : un commentaire pèse bien davantage qu’un like ou un partage.

Cette hiérarchisation repose sur un principe : l’engagement actif – donc le commentaire – serait un meilleur indicateur de pertinence que les réactions passives. Pourquoi pas ? C’est d’ailleurs le cas depuis les débuts de ces réseaux. Ce mécanisme favorise précisément les émotions radicales et la désinformation. C’est connu et c’est ce qu’utilisent abondamment les mouvances politiques et les États pour mener leurs campagnes de manipulation. Mais là où X va plus loin, c’est que l’algorithme est également influencé par des partis pris qui n’ont pas grand-chose à voir avec les critères d’engagement.

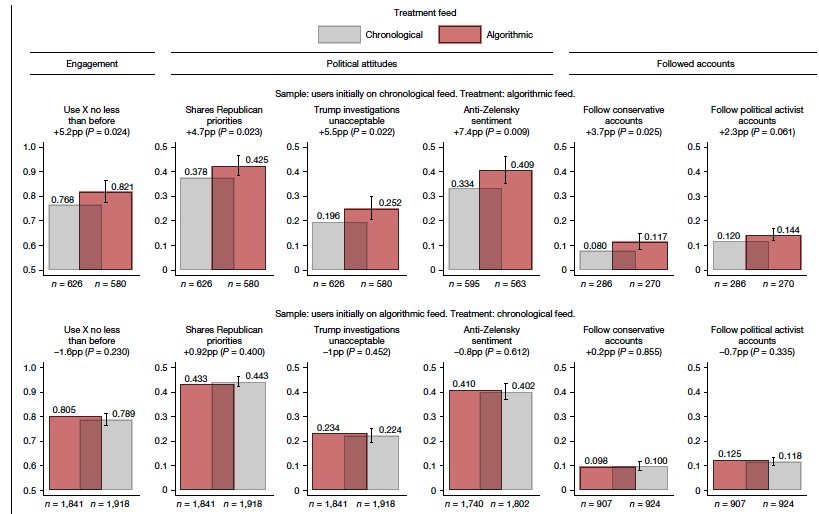

L’étude menée en 2023 auprès de 5 000 personnes, montre que le fil algorithmique « Pour vous » augmente la visibilité des contenus publiés par les activistes politiques conservateurs. Les contenus visant à prouver que les enquêtes pénales menées à l’époque contre Trump sont inacceptables mis en avant. Il en est de même pour les ressentiments négatifs à l’encontre du président ukrainien Zelensky. © Nature

Ainsi, pendant sept semaines en 2023, près de 5 000 utilisateurs américains ont été exposés, soit au fil algorithmique « Pour vous », soit à un fil de contenus publiés sur X strictement chronologique, basé sur leurs abonnements.

Le résultat est sans ambiguïté : les utilisateurs soumis à l’algorithme ont vu leurs opinions évoluer vers des positions plus conservatrices. C’était notamment le cas à l’époque sur les priorités politiques et les enquêtes pénales visant Donald Trump. En suivant ce fil, les probabilités que le lecteur ait des doutes sur les affaires dans lesquels Trump était empêtré, au moment de l’enquête, augmentaient fortement. Tout était fait pour pousser les arguments des Républicains et leurs tendances.

Tags :

tech

L’IA est-elle en train de débrancher notre esprit critique ? Une surprenante étude tire la sonnette d’alarme !

Lire l’article

De même, les informations poussées sur l’Ukraine et sur le président Zelensky avaient également de grandes chances d’inciter à prendre le parti et le narratif de la Russie. En approfondissant la lecture de l’étude, on peut constater que ce fil « Pour vous » ne laisse en réalité que peu de place aux médias d’information. En revanche, il fait abondamment la promotion des activistes politiques et notamment des plus conservateurs. Le problème, c’est que ce n’est pas spécialement par « engagement » sur un sujet, mais par choix.

Cela fonctionne aussi en France

Et si l’étude portait sur un public américain en 2023, ce constat semble toujours s’appliquer en Europe, notamment lors des dernières élections.

Ainsi, en Allemagne, lors des élections fédérales de 2025, le parti d’extrême droite AfD, ouvertement soutenu par Elon Musk, occupait une place démesurée dans le fil « Pour vous ». Le taux de visibilité était délirant alors que les publications du parti ne représentaient qu’une toute petite partie du volume total des tweets des comptes politiques.

Le même phénomène semble s’être produit en France pour les municipales de Paris en faveur de la candidate Sarah Knafo du parti d’extrême droite Reconquête ! Très proche de la mouvance MAGA américaine, durant la campagne, les publications de la candidate connaissaient une visibilité étrangement exceptionnelle dans cette rubrique « Pour vous ». Une visibilité qui ne correspondait pourtant pas aux critères énoncés par le réseau social.

Une petite musique qui entre dans les cerveaux

Une autre enquête menée en 2025 sur la politique au Royaume-Uni montrait que plus de 60 % des contenus politiques recommandés provenaient de comptes des conservateurs. Certains profils marginaux y bénéficiaient d’une amplification disproportionnée, bien au-delà de leur audience organique.

Au final dans de nombreux cas, cela ne s’est pas toujours traduit par de bons résultats dans les urnes pour les candidats bénéficiant de ce soutien algorithmique. Reste que l’étude de Nature et les autres montrent que cette profusion de publications allant toujours dans un certain sens, produit quand même un « bruit de fond ».

Tags :

tech

Vous croyez être libre ? Voici comment les algorithmes vous manipulent au quotidien

Lire l’article

Cette « petite musique » répétitive finit par faire douter et changer d’opinion sur certains sujets. Autrement dit, cela fonctionne. « L’engagement » qui reste le fond de commerce de X marche également et vient renforcer le phénomène.

Autre constat des chercheurs : après cette « intoxication » par les contenus algorithmiques de « Pour vous », il n’est pas possible de revenir en arrière pour l’utilisateur. S’il ne se rend que sur le fil chronologique de ses abonnements, des informations plus nuancées n’y changeront rien. Son avis est modifié durablement.

Des réponses juridiques ?

Si de nombreuses études solides pointent ce phénomène et cette manipulation par le réseau d’Elon Musk, comment atténuer sa portée ? En raison de l’application du DSA (Digital Services Act), les menaces d’amendes colossales de l’Union européenne envers X, concernant le non-respect des obligations de transparence, ont engendré le courroux de Musk et le soutien de l’administration Trump. Cette défiance qui concerne un réseau social privé s’est même transformée en tension géopolitique.

En réponse et pour éviter une lourde sanction, dernièrement, X a bien ouvert une partie de son algorithme avec la publication de son code de recommandation. Elon Musk a aussi promis des mises à jour tous les quatre mois. Mais cette transparence reste largement partielle et insatisfaisante pour l’Europe. Seuls certains modules sont accessibles, sans les données ni paramètres clés. Surtout, le code publié ne reflète pas toujours le système réellement déployé, car il reste en constante évolution. Enfin, avec l’intégration de modèles d’intelligence artificielle plus complexes, l’audit externe devient encore plus difficile.

Alors, pour les régulateurs européens, il va falloir faire autrement. Puisque l’enjeu n’est plus l’accès au code, la solution pourrait reposer dans la capacité à en mesurer concrètement les effets par rétro-ingénierie, comme finalement le font les auteurs de ces différentes études.

Source:

www.futura-sciences.com