L’apprentissage est une faculté essentielle permettant aux humains et aux animaux non-humains d’extraire de l’information de leur environnement, d’en détecter les régularités, de les retenir et de les réutiliser à bon escient. Plusieurs questions taraudent les psychologues et les éthologues à son propos : comment apprenons-nous ? Qu’est-ce qui détermine que nous développons telle ou telle stratégie d’apprentissage, que nous choisissons d’utiliser telle ou telle stratégie acquise ?

Depuis l’émergence de ces deux disciplines, nous comparons les performances des humains et des animaux non-humains dans le but de mieux comprendre nos psychologies respectives. Désormais, avec l’arrivée de l’intelligence artificielle (IA) moderne, nous pouvons également réaliser des études de psychologie comparée entre les humains et les machines.

Tags :

sante

Rentrée scolaire : comment stimuler et booster l’apprentissage de vos enfants ?

Lire l’article

Dans cette étude, le point de départ de la réflexion des deux chercheurs à l’origine de l’article paru dans Nature Human Behavior est la capacité des grands modèles de langage actuels à switcher entre des formes distinctes d’apprentissage. Jacques Pesnot Lerousseau, chercheur en sciences cognitives à l’université d’Aix-Marseille et auteur principal de l’article raconte : « Nos questions émergent d’un résultat connu dans la littérature en machine learning : ces réseaux développent et adoptent des stratégies d’apprentissage différentes. Pourquoi privilégient-ils la mémorisation associative dans certains cas et la mémorisation d’une règle d’inférence dans d’autres ? Et qu’en est-il chez les humains qui partagent évidemment cette capacité à switcher entre les stratégies d’apprentissage ? »

Avec l’arrivée de l’IA moderne, on peut comparer les neurones des humains et ceux des machines. © Arkadiusz Warguła, iStock

L’architecture de réseaux de neurones qui a tout changé

Si, depuis une décennie, « les humains ont perdu le monopole du langage » (formule que je reprends à Thibaut Giraud, docteur en philosophie, vidéaste de la chaîne Mr Phi et auteur de l’excellent La parole aux machines aux éditions Grasset), les entités biologiques ont perdu celui de l’apprentissage depuis bien plus longtemps encore.

En effet, les machines peuvent apprendre en un sens relativement rudimentaire depuis les débuts du machine learning. Mais certaines d’entre elles sont désormais capables de formes assez avancées d’apprentissage. Ce sont celles qui sont constituées de réseaux de neurones dont l’architecture la plus répandue porte le nom de Transformer.

« Les modèles et réseaux actuels sont entraînés à prédire le token (une unité textuelle généralement plus petite qu’un mot, ndlr) suivant le plus probable à partir d’une séquence textuelle fournie en entrée. L’architecture transformer permet de mixer les représentations du modèle, prenant la forme de liste de nombre, de chaque token. Après apprentissage, ces dernières se structurent de façon à ce que les réseaux de neurones puissent réaliser des opérations sémantiques, si bien qu’au sein d’un texte, la représentation de chaque token s’influence mutuellement », explique Jacques Pesnot Lerousseau.

Tags :

tech

Le machine learning, un apprentissage automatique

Lire l’article

Pour bien comprendre, le chercheur nous propose un exemple : « Prenez une phrase qui comporte un mot ambigu, disons le mot chaîne. Si je commence la phrase suivante « j’écoute de la musique sur une chaîne… » et que le modèle doit prédire ce qui vient ensuite, il doit lever l’ambiguïté résiduelle autour du mot chaîne car, pris isolément, il peut avoir plusieurs sens : une chaîne en métal, une chaîne hi-fi, une chaîne de télévision. Lors de la première couche (les réseaux de neurones sont constitués de couches successives de neurones artificielles réalisant différentes fonctions, ndlr) le modèle va simplement associer chaque token avec son vecteur numérique (c’est-à-dire sa représentation sous forme de nombre, ndlr). Cette étape ne permet pas de désambiguïser la situation. Lors des couches suivantes, c’est là que le mixage des représentations dont nous parlions plus haut se produit. Par exemple, le fait que le mot musique soit présent dans la phrase va favoriser la représentation de chaîne comme étant un appareil sur lequel on écoute de la musique. »

Deux dimensions de l’intelligence et deux types d’apprentissage

En psychologie, on distingue grossièrement deux grandes dimensions de l’intelligence (en réalité, il en existe cinq, mais elles ne vont pas toutes nous intéresser ici) :

l’intelligence cristallisée qui réfère à des connaissances stables et statiques ;l’intelligence fluide qui réfère à des capacités de raisonnement.

Pour nous aider à les distinguer, Jacques Pesnot Lerousseau nous propose un nouvel exemple : « On peut avoir plusieurs manières de résoudre une tâche. Par exemple, si je vous demande de me donner le résultat de 2 x 4, vous allez puiser dans les choses que vous connaissez par cœur. À l’inverse, si je vous demande de me donner le résultat de 6 x 13, vous allez réaliser le calcul à l’aide de règles dont vous vous souvenez. Dans les deux cas, la tâche est la même – réaliser une multiplication – mais la stratégie que vous allez utiliser va varier. Néanmoins, que vous choisissiez l’une ou l’autre, celle-ci fait toujours appel à de la mémoire – mémoire par association ou mémoire du processus d’inférence. »

En psychologie, on distingue deux grandes dimensions de l’intelligence : la fluide et la cristallisée. © ImageFlow, Adobe Stock

Ces deux dimensions de l’intelligence ressemblent fortement à deux stratégies d’apprentissage développées par les humains et par les IA que l’on nomme respectivement apprentissage in-weight (se rappeler d’une association entre un item et son label, typiquement se rappeler que 2 x 4 = 8) et l’apprentissage in-context (le fait de se rappeler d’une règle d’inférence, d’un processus de réflexion, typiquement se rappeler que pour multiplier 6 et 13, il faut multiplier 6 et 3 et retenir 1, puis 6 et 1 et ajouter la retenue, pour enfin assembler les deux chiffres ce qui nous donne 78).

Tags :

sciences

Oubliez la valeur unique du QI, votre intelligence se décompose en une pyramide

Lire l’article

Jacques Pesnot Lerousseau revient sur cette distinction : « l’apprentissage in-weight réfère à la modification des forces de connexions des neurones artificiels à travers les couches pendant l’apprentissage du réseau. Dans notre travail, cela correspond à une association que le modèle a réalisée. L’apprentissage in-context correspond à une autre stratégie que le modèle a également acquise en modifiant des connexions, mais il a appris à extraire de l’information à l’aide d’une règle d’inférence là où l’apprentissage in-weight se cantonne à de l’association. Pour simplifier, la première stratégie permet d’apprendre – on parle de learning – et la seconde permet d’apprendre à apprendre – on parle de meta-learning – à partir d’un contexte. »

Les réseaux de neurones sont sensibles à la distribution statistique des données

L’étude de Jacques Pesnot Lerousseau s’insère dans une littérature extrêmement fournie en machine learning et reprend un résultat d’une importance cruciale pour construire son expérience : les transformers développent des stratégies d’apprentissage in-context en réaction à une certaine distribution statistique des données (c’est-à-dire à une certaine fréquence d’apparition), mais sont aussi enclins à développer des stratégies d’apprentissage in-weight.

Lorsque les données d’entraînement sont très redondantes (la distribution statistique est donc très asymétrique), c’est-à-dire que le même exemple réapparaît sans cesse, ils privilégient la stratégie in-weight. À l’inverse, lorsque les données d’entraînement sont très diverses (la distribution statistique est donc très uniforme), c’est-à-dire qu’il n’y a pratiquement que des exemples nouveaux, ils privilégient la stratégie in-context.

Ce résultat a fait naître une interrogation psychologique chez Jacques Pesnot Lerousseau : « Si les chercheurs en machine learning ont des préoccupations plutôt pragmatiques, comme favoriser l’apprentissage in-context car c’est la capacité la plus intéressante en matière de généralisation et d’efficacité, cela pose également une question psychologique plus fondamentale : est-ce que l’humain est sensible à la distribution statistique des données de la même façon que les transformers ? »

Pourquoi comparer les humains et les réseaux de neurones ?

Hormis la longue tradition d’aller-retour existante depuis la seconde moitié du XXe siècle entre le domaine de l’IA et celui des neurosciences, on peut se demander quelle est la raison qui pousse les chercheurs en psychologie à réaliser ce type de comparaison.

Jacques Pesnot Lerousseau justifie ce choix à l’aide de deux arguments : « Premièrement, cette approche nous permet de formuler des hypothèses mécanistiques. En effet, les calculs effectués par les réseaux profonds sont appris à partir de l’expérience et ne sont pas explicitement définis ou imposés par le chercheur. Cela permet d’explorer quelles représentations ou stratégies émergent spontanément pour résoudre la tâche. Deuxièmement, elle permet d’opérationnaliser l’approche dite de l’observateur idéal (qui existe aussi dans le champ de la philosophie morale, ndlr), qui part du fonctionnement des humains et où on se demande si un agent idéalement optimisé pour réaliser le mieux possible une tâche montre un fonctionnement similaire. Cela permet de comprendre si certains biais humains sont des erreurs ou des déviations optimales dues à l’environnement. Par exemple, un résultat connu dans cette littérature montre qu’un modèle optimisé pour discriminer des orientations d’images naturelles va être très légèrement biaisé vers des orientations cardinales, comme les humains. L’explication proposée est que cette tendance va se développer en réaction à ses données d’entraînements. Dans notre étude, le réseau de neurones joue le rôle de l’observateur idéal. »

Dans cette étude, le réseau de neurones joue le rôle de l’observateur idéal. © D. Ichbiah via Dall-e 3

La construction d’un nouveau design expérimental

À présent, nous pouvons rentrer dans le vif du sujet et parler de l’apport de l’étude de Jacques Pesnot Lerousseau et de son co-auteur. Son ingéniosité réside dans la création d’une nouvelle tâche. « On a construit une tâche dans laquelle les humains/transformers peuvent recourir à l’une ou l’autre des deux stratégies d’apprentissage », précise le chercheur. L’idée est simple : entraîner des humains et des petits réseaux de neurones à la même tâche (associer des images avec des nombres) en faisant varier la distribution statistique des données d’entraînements, puis les soumettre aux mêmes évaluations.

Tags :

tech

Des chercheurs chinois ont créé une IA inspirée du cerveau humain… et elle ridiculise les modèles classiques

Lire l’article

Il y a donc une première phase d’apprentissage où l’on présente des images associées à des nombres en faisant varier la distribution des exemples d’entraînements sur un spectre allant de très redondants (toujours le même exemple) à très divers (uniquement des exemples différents).

Ensuite, les phases de tests se présentent sous la forme d’un environnement numérique avec une image centrale (qui est l’image qu’on doit associer à son nombre) et des nombres apparaissant en cercle autour de cette image avec des lettres ou avec des images.

Dans le cas où les nombres apparaissent avec des lettres, les humains/transformers ne peuvent recourir qu’à l’apprentissage in-weight étant donné qu’aucune règle ne permet de trouver la bonne réponse. Par contre, dans le cas où les nombres apparaissent avec des images, l’image centrale apparaît également dans le cercle et elle précède toujours son nombre de trois places. Dans cette variante, recourir à l’apprentissage in-context devient possible et les humains/transformers vont devoir décider quelle stratégie ils souhaitent adopter.

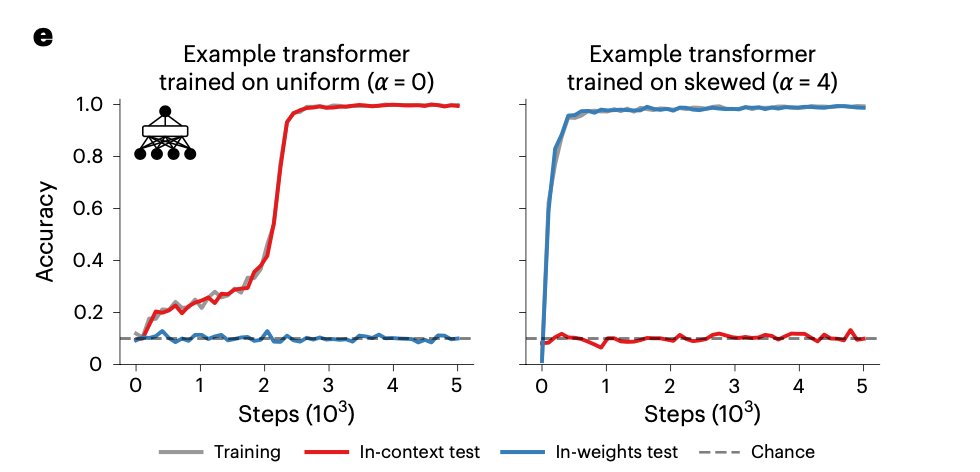

Les humains partagent la sensibilité à la distribution statistique des données

Dans cette étude, on retrouve le résultat connu dans la littérature en machine learning : les modèles ayant été entraînés avec des données de types in-weight ou in-context, sont biaisés en faveur de la stratégie qui correspond à leur données d’entraînement. Cela aboutit à des performances très élevées dans le cas où les tests sont congruents avec les données et à une chute radicale de ces dernières si les tests ne sont pas congruents avec ces mêmes données.

Les performances des transformers entraînés sur une distribution uniforme (à gauche) et asymétrique (à droite). © Nature Human Behavior

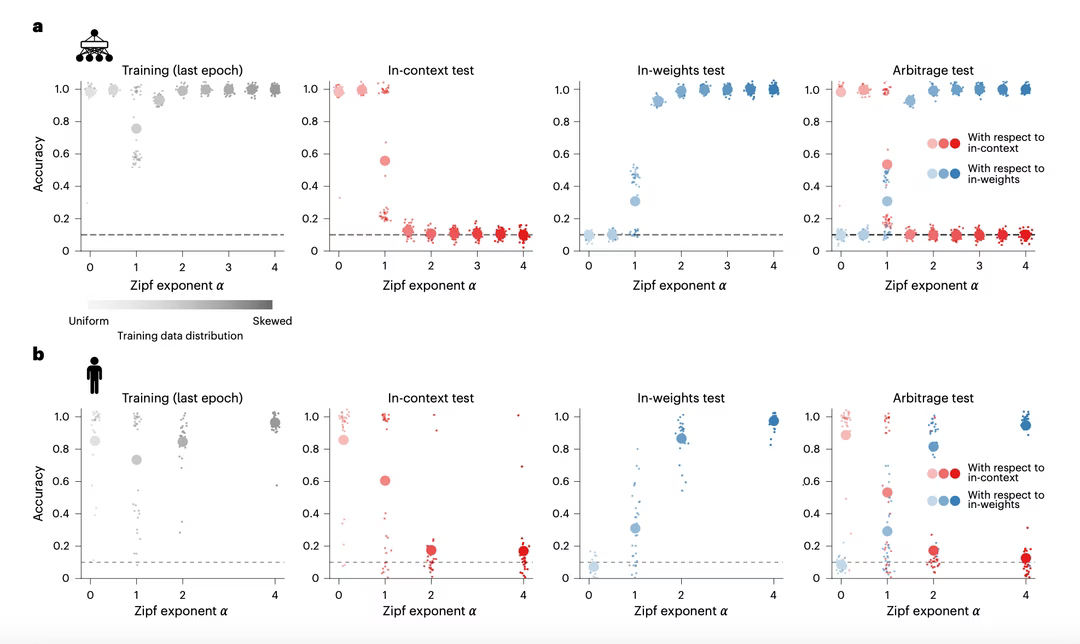

Le résultat principal et novateur de cette étude concerne la comparaison avec les humains. Premièrement, les humains partagent bien avec les transformers cette sensibilité à la distribution statistique des données d’entraînement. Deuxièmement, en moyenne, le point de bascule qui fait switcher les humains/transformers d’une stratégie à une autre se situe à α = 1 (α étant l’indice d’asymétrie de la distribution, 0 correspondant à une distribution uniforme, 4 à une distribution extrêmement asymétrique).

Le point de bascule à α = 1, bien visible chez les humains et les transformers. © Nature Human Behavior

Mais les chercheurs sont allés encore plus loin. Ils démontrent également que les humains et les transformers peuvent développer les deux stratégies si les données proviennent aléatoirement d’une distribution qui mixe à la fois des exemples redondants et nouveaux. En conséquence, ils deviennent plus facilement ce que les chercheurs appellent des doubles-apprenants : « Face à une distribution qui promeut les deux formes d’apprentissage, on arrive à dégager les deux stratégies chez les humains et chez les transformers », résume Jacques Pesnot Lerousseau.

La flexibilité, le propre de l’humain ?

Pour ne pas s’arrêter en si bon chemin, Jacques Pesnot Lerousseau et son co-auteur ont tenté de répondre à une autre question : que se passe-t-il si l’on entraîne les humains/transformers en commençant par une distribution statistique de données très uniforme/asymétrique et que l’on termine l’entraînement par une distribution très asymétrique/uniforme ?

Selon les résultats obtenus par les deux chercheurs, seuls les humains parviennent à bénéficier d’un apprentissage commençant par une structure uniforme afin de devenir des doubles-apprenants : « Contrairement aux humains, les réseaux de transformers de petite taille que l’on utilise dans l’étude oublient la stratégie d’apprentissage lorsque la distribution statistique des données change radicalement. Le changement brutal de tâche produit ce qu’on appelle une interférence catastrophique », souligne Jacques Pesnot Lerousseau avant de poursuivre dans les explications : « Lors du changement de tâche, le réseau va modifier l’ensemble de ces paramètres pour s’adapter mais ce faisant, il va altérer ceux qui étaient utilisés pour la tâche précédente. Résultats des courses : le modèle désapprend la stratégie promue par les premières données d’entraînement. »

Selon l’ordre dans lequel on présente les différents types de données d’entraînement, les humains sont plus ou moins flexibles dans leur apprentissage. © Ulia Koltyrina, Adobe Stock

Cependant, la flexibilité des humains ne fonctionne que dans un sens. Si l’apprentissage commence par une distribution asymétrique, les bénéfices s’écroulent. « Nous avons montré qu’il existe un effet d’asymétrie chez les humains selon qu’on commence par les exposer à une distribution asymétrique ou uniforme. Si on commence par les entraîner sur une distribution uniforme, ils trouvent la règle et ils ne l’oublient pas lorsqu’on termine l’entraînement avec une distribution asymétrique. Ils vont simplement retenir par cœur l’item correspondant à l’exemple redondant de la distribution asymétrique en plus. Par contre, si on change l’ordre, la redondance initiale des données porte préjudice au développement de la stratégie d’apprentissage in-context. À titre d’hypothèse, cela pourrait s’expliquer par le fait que les humains restent dans un mode d’apprentissage in-weight et perdent du temps pour identifier la règle », suggère Jacques Pesnot Lerousseau.

Différents supports, même processus

Pour finir, les chercheurs ont voulu aller encore plus loin et comprendre comment les humains/transformers avaient résolu les tâches in-context auxquelles on les avait soumis. À l’aide des méthodes novatrices d’interprétabilité (caricaturalement, les neurosciences des machines) et du mouse tracking (une technique utilisée en psychologie cognitive pour traquer les processus cognitifs humains lors de tâches réalisées sur ordinateur), les deux chercheurs ont mis en évidence que les humains et les transformers utilisaient un mécanisme d’induction similaire lors des phases de test, composé de deux étapes : relier l’item central à son homologue dans le cercle, puis chercher la solution trois places plus loin dans l’environnement de test.

Et si certaines IA étaient déjà conscientes… sans qu’on le sache ?

Lire l’article

Quels éléments leur ont permis de tirer cette conclusion ? Jacques Pesnot Lerousseau détaille ce point : « Vous vous souvenez des listes de nombres correspondant aux représentations internes du modèles dont nous parlions au début ? Eh bien, il est possible de les visualiser sur un graphique et de regarder ce qui se passe à toutes les couches du modèle lorsqu’on a un tout petit réseau. Par conséquent, que ce soit chez les humains à l’aide des mouvements de la souris et des scores d’attention des différentes couches du modèle, on voit très clairement les deux étapes du mécanisme d’induction apparaître. »

Un cadre très réductionniste

Avant de se quitter, il faut insister sur le fait que ces résultats ont été obtenus dans un cadre ultra-réductionniste, en réalisant des simplifications conceptuelles considérables et avec des réseaux de neurones infiniment plus petits que ceux qui gouvernent actuellement les grands modèles de langage.

« Comme souvent en psychologie cognitive, on étudie un phénomène en le réduisant énormément, en simplifiant à l’extrême des concepts comme l’intelligence fluide et cristallisé qui ont une portée bien plus large que ce qu’on fait faire aux participants et aux transformers dans l’étude et en utilisant des modèles à taille humaine. Il est fort probable que les grands modèles de langage aient des capacités différentes, résistent à l’interférence catastrophique ou apprennent d’une manière différente », prévient Jacques Pesnot Lerousseau avant d’ironiser : « on a compris ce qui se passait en jouant dans un bac à sable avec un modèle et une tâche excessivement simplistes. Remonter le fil de la complexité sera nécessairement plus coûteux en temps et en énergie ».

Source:

www.futura-sciences.com